Mire la demostración de NPC AI de Nvidia e imagine que en realidad está hablando con personajes de juegos de IA.

Espero que se vea tan bien cuando el juego y la IA estén completamente entrelazados.

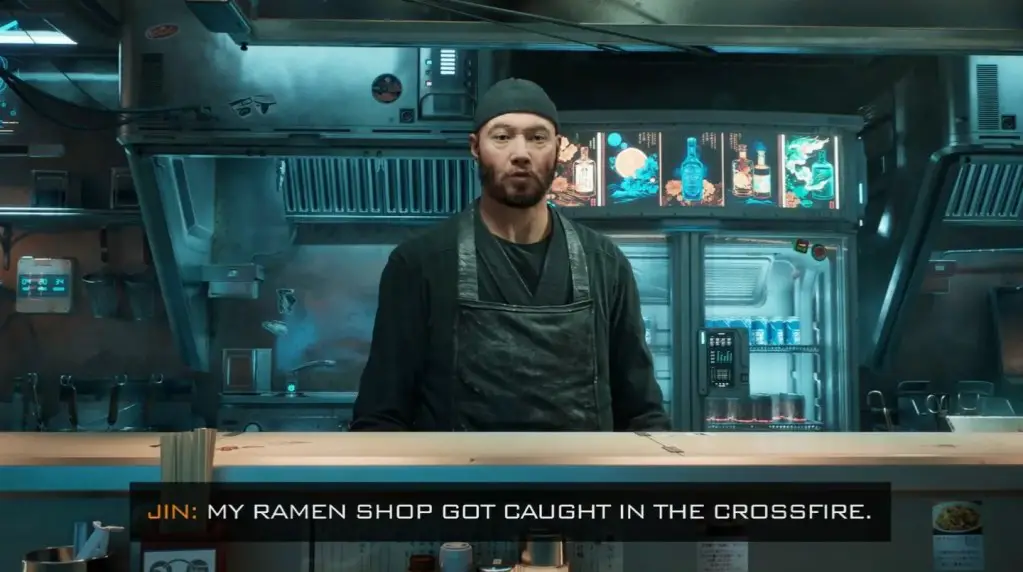

En Computex 2023 en Taipei, el CEO de Nvidia, Jensen Huang, le dio al mundo una idea de cómo podría ser cuando los juegos y la inteligencia artificial chocan, con una exhibición gráficamente impresionante de una tienda de ramen cyberpunk donde puedes hablar con el propietario.

En serio, imagina que en lugar de hacer clic en las opciones de diálogo, puede mantener presionado un botón, decir algo con su propia voz y obtener una respuesta de un personaje de videojuego. Nvidia lo llama "un vistazo al futuro de los juegos".

Desafortunadamente, el diálogo real deja mucho que desear.

Aquí está la transcripción completa del discurso:

Jugador: Hola Jin, ¿cómo estás?

Jin: Desafortunadamente no es tan bueno.

Como es

Estoy preocupado por los crímenes aquí. Ha empeorado últimamente. Mi tienda de ramen ha sido objeto de fuego cruzado.

¿Puedo ayudar?

Si quieres hacer algo al respecto, he oído rumores de que el poderoso señor del crimen Kumon Aoki está provocando todo tipo de caos en la ciudad. Él puede ser la fuente de esta violencia.

Hablaré con él, ¿dónde puedo encontrarlo?

Escuché que pasas el rato en clubes clandestinos de lucha en el lado este de la ciudad. Prueba allí.

Está bien, me voy.

Ten cuidado Kai.

Al ver un solo video de una sola conversación, es difícil ver cómo esto es mejor que elegir de un árbol de diálogo NPC, pero la parte impresionante es la respuesta de la IA generativa al habla natural. Espero que Nvidia publique la demostración para que podamos probarla nosotros mismos y obtener resultados completamente diferentes.

La demostración incluye las herramientas utilizadas por Nvidia y su socio Convai para crear la demostración, específicamente para juegos que pueden ejecutarse tanto localmente como en la nube. Nvidia ACE (motor de nube de Avatar)Fue creado para ayudar a promover un paquete de middleware llamado . Toda la suite ACE incluye las herramientas NeMo de la compañía para implementar modelos de lenguaje extenso (LLM), como Riva de voz a texto y de texto a voz.

Te puede interesar: Elon Musk funda una empresa de inteligencia artificial llamada X.AI

La demostración usa más de estos, por supuesto: está integrado en Unreal Engine 5 con mucho trazado de rayos... y es tan impresionante visualmente que la parte del chatbot se siente mediocre en comparación conmigo. En este punto, hemos visto conversaciones que son mucho más atractivas que los chatbots, sin importar cuán estereotipadas y derivadas sean a veces.

En la sesión informativa preliminar de Computex, el vicepresidente de la plataforma GeForce de Nvidia, Jason Paul, dijo que sí, la tecnología podría escalar a varios caracteres a la vez y, en teoría, incluso permitir que los NPC se comuniquen entre sí, pero admitió que no la había visto probada.

No está claro si algún desarrollador adoptará todo el conjunto de herramientas de ACE como intento de demostración, pero STALKER 2 Heart of Chernobyl y Fort Solis usarán la parte que Nvidia llama "Omniverse Audio2Face", que intenta hacer coincidir la animación de la cara de un personaje en 3D con la voz. discurso del actor.

¿Qué opinas sobre este tema? No olvides compartir tus pensamientos con nosotros en la sección de comentarios. Para todo nuestro contenido The Gamer Station Todos los contenidos

Los productos discutidos aquí han sido seleccionados de forma independiente por nuestros editores. Si compra algo que aparece en nuestro sitio, The Gamer Station puede recibir una parte de los ingresos.

El idioma original de los artículos es el turco. Transmitimos en 18 idiomas diferentes. Si ve una oración o palabra incorrecta en el contenido, ¡no dude en informarnos en los comentarios!